Задача

Клиенты шлют фото, а менеджеры работают "машинистками"

Я автоматизирую процессы для магазина запчастей. Ниша сложная: здесь покупатели часто сами не знают, как называется деталь. Им лень искать и переписывать длинные заводские коды.

Сценарий почти всегда один: человек фотографирует шильдик холодильника, коробку или саму сломанную запчасть и отправляет фото в мессенджер магазина.

Для отдела продаж это превращалось в бесконечную рутину:

-

- Потеря времени: менеджер должен открыть картинку, увеличить её, разбирать мелкий или стертый шрифт.

- Ручной ввод: приходится вручную перебивать цифры с картинки в заголовок лида в Битрикс24.

- Ошибки: одна опечатка в артикуле и деталь в базе не находится.

Мне нужно было исключить человеческий фактор на этапе ввода данных.

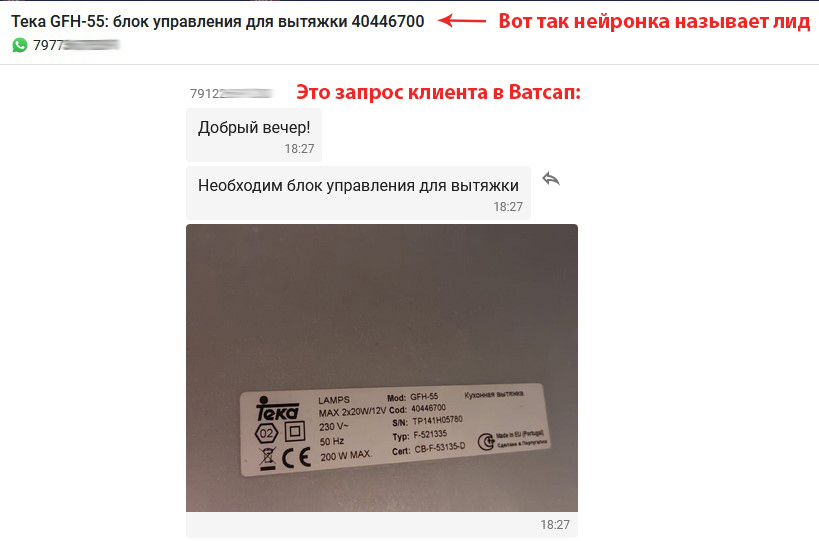

Цель: сделать так, чтобы Битрикс24 сам "видел", что изображено на фото, распознавал артикулы и бренды, и мгновенно заполнял название лида. Менеджер должен получать уже готовую заявку: "Запрос: тэн Samsung DC47-00006J", а не просто "Входящее сообщение".

Решение

Нейросеть, которая собирает пазл из текста и фото.

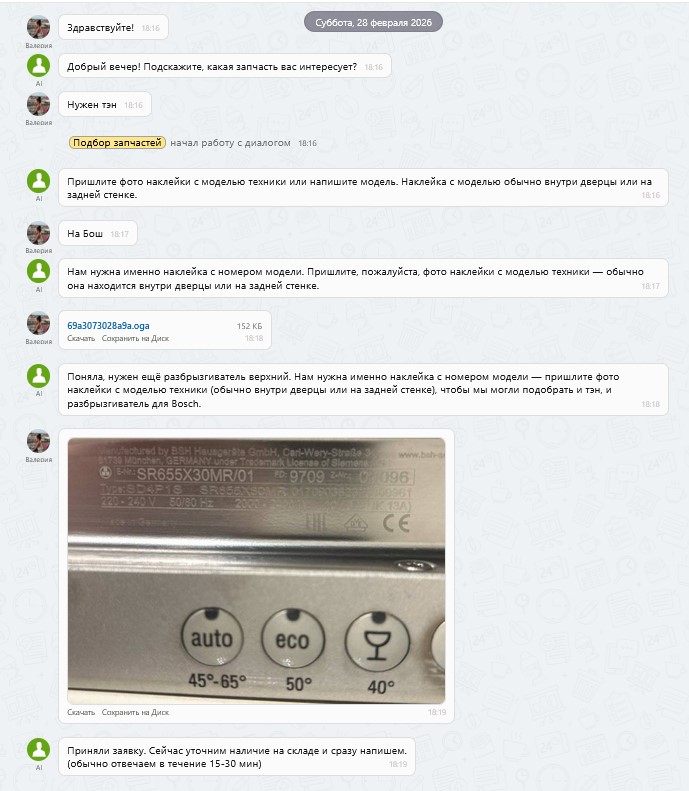

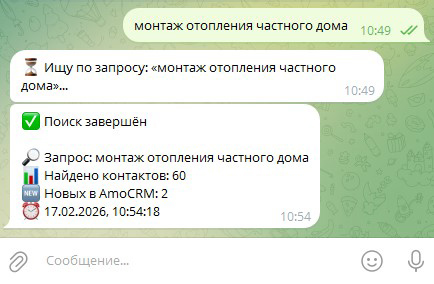

Я настроил систему в так, чтобы она работала в разных мессенджерах (WhatsApp, Telegram) и умела объединять разрозненные сообщения в одну картину.

Главная фишка решения - это логика последовательного обогащения. Робот читает диалог и на лету дописывает данные в карточку лида, как только получает новую информацию.

Вот как это работает на практике (сценарий "текст + фото"):

Шаг 1. Обработка запроса (текст)

Клиент пишет: "Здравствуйте, нужен тэн".

ИИ очищает сообщение от приветствий, понимает суть запроса и сразу меняет название лида в Битрикс24 на: "ТЭН"*.

Шаг 2. Анализ изображения (Vision)

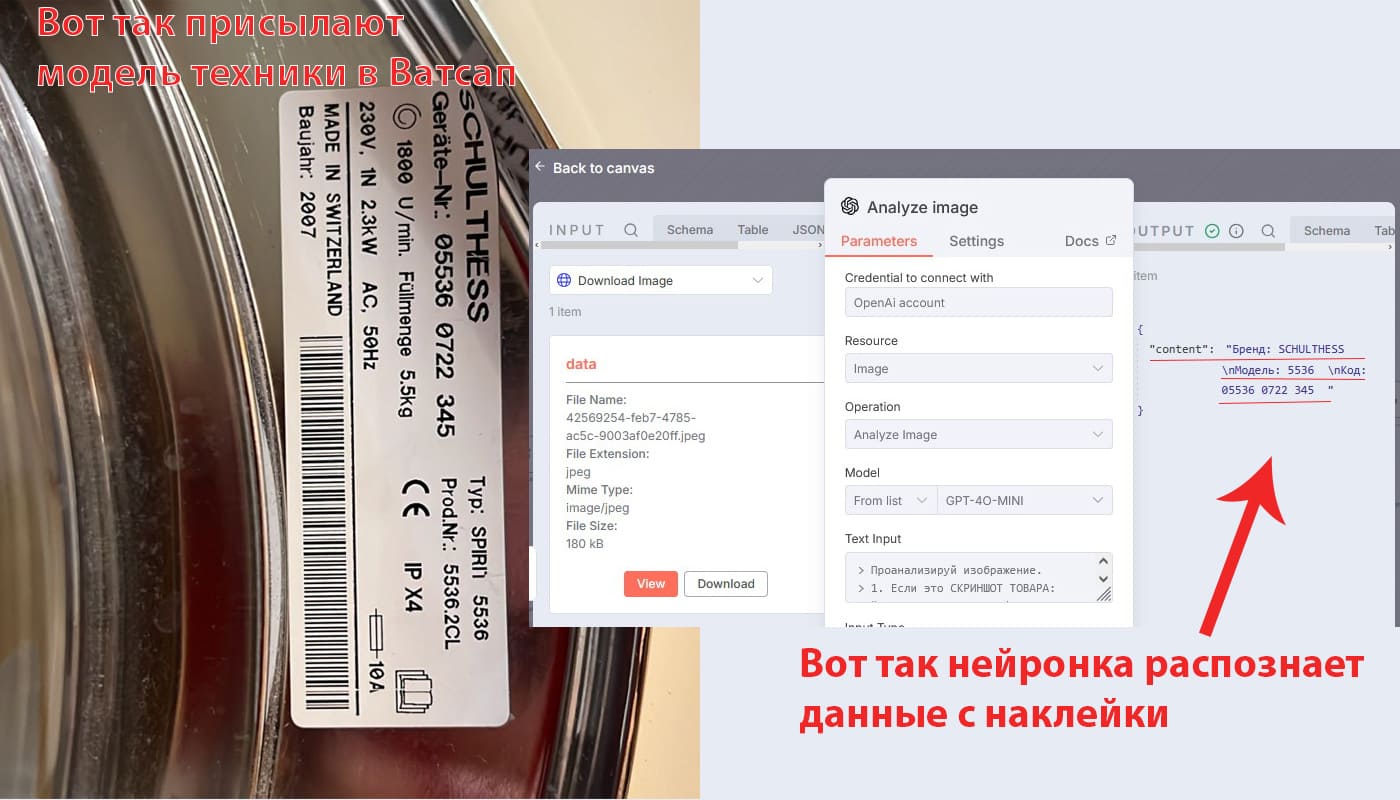

Следом клиент присылает фото. Тут включается компьютерное зрение (GPT-4o Vision), которое определяет тип снимка:

Сценарий А (Фото детали): Если на фото сама запчасть с маркировкой, ИИ вытаскивает артикул. Название лида обновляется: "ТЭН [артикул с фотографии]".

Сценарий Б (Фото шильдика): Если клиент прислал фото наклейки с моделью техники (что бывает чаще всего), ИИ извлекает точное название модели.

Шаг 3. Финальная сборка

Система делает "ход конем":

1. Записывает модель (например, Samsung WF8590) в отдельное специальное поле лида "Модель техники".

2. Обновляет заголовок, объединяя данные из текста и фото.

Было: "ТЭН"

Стало: "ТЭН для Samsung WF8590"

Итог для менеджера:

Сотрудник открывает Битрикс24 и видит полностью заполненную карточку. Ему не нужно вглядываться в смазанные фото наклеек, разбирать цифры 0 и 8 или перепечатывать английские буквы. Всё уже распознано, исправлено и вписано в нужные поля.

Результат

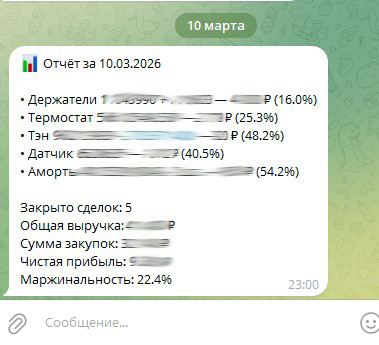

Ускорение обработки и цена вопроса

Внедрение этой связки решило три конкретные бизнес-задачи, которые не закрывала обычная автоматизация:

- 1. Убрали этап расшифровки

Менеджеры больше не тратят время на разглядывание фотографий. Им не нужно открывать картинку, увеличивать смазанный шильдик и пытаться понять: это цифра "8" или буква "B".

Сотрудник получает готовые данные в текстовом виде. Время обработки заявки с фото сравнялось с обработкой обычного текстового сообщения. - 2. Исключили опечатки в артикулах

Человеку сложно перепечатать серийный номер из 15 символов без ошибок, особенно в спешке. Одна опечатка и деталь на складе "не найдена", хотя она там есть.

Нейросеть просто копирует символы с изображения. Точность ввода данных выросла до 99%, что напрямую влияет на количество успешных продаж. - 3. Разрешили клиентам быть "ленивыми"

Мы не заставляем покупателя искать название модели и вбивать его вручную. Сценарий "сфоткал и отправил" самый конверсионный. Мы сохранили удобство для клиента, но при этом дали менеджеру структурированные данные, а не просто картинку в чате.

Цена эксплуатации

Самый частый вопрос: "А не разорит ли нас GPT в повседневной обработке?"

Я замерил расходы на реальном потоке. При активной переписке (обработка сотен текстовых сообщений и десятков тяжелых фото в сутки) затраты на API OpenAI составляют до 20 рублей в день. Это цена одной минуты работы менеджера, которая экономит часы.